Спустя пару недель после тестирования хайпового бота ChatGPT я встроил его почти во все свои регулярные процессы : поиск литературы, изучение языка, развитие навыков, самообразование, и т. д. Некоторые из них ускорились более чем в десять раз. На мой взгляд те кто решают схожие задачи и не осваивают эту технологию будут сильно проигрывать в перспективе.

Те же, кто нашел для себя ряд работающих запросов и связок из них получают почти что несправедливое преимущество. В статье я хочу рассмотреть подходы к инженерии запросов. То есть к тому чтобы с помощью запросов добиться от условного искусственного интеллекта нужного результата под ваши задачи.

Для кого статья?

Если отвечать кратко - для тех кто решает задачи сходные тем что описаны в статье. В первую очередь это самообразование, информационная работа, информационный поиск, развитие некоторых навыков.

Но на самом деле я и сам не знаю. Дело в том что есть ряд типовых задач для языковой модели вроде поиска по смыслу, а не по словам. Но постоянно находятся новые способы применения детища OpenAI. Ну и , разумеется, я рассчитываю что Вы уже потрогали чат-бота руками. Статья о том как зайти из России.

Ошибки взаимодействия с ChatGPT

Какая бы задача перед нами ни стояла взаимодействие с чатботом может легко превратиться в нелепый анекдот. Который сгодится разве что для рассказа в компании друзей. Поэтому кратко рассмотрим несколько ошибок и ограничений взаимодействия с ChatGPT.

1 - Попытки доказать что “железяка глупая”

В целом это относится к любой плюс минус умной технологии. Какая то часть пользователей вместо того чтобы понять какие возможности перед ними открываются пытаются всеми силами доказать что вот новомодный ИИ ничего не может и не умеет.

Детский барьер, однако распространенный. Конечно ограничения понимать нужно, но не в такой форме. Поэтому явно формулируем решаемую задачу и идем далее.

2- Незнание как обходить ограничения

У ChatGPT их довольно много. Некоторые можно обойти.

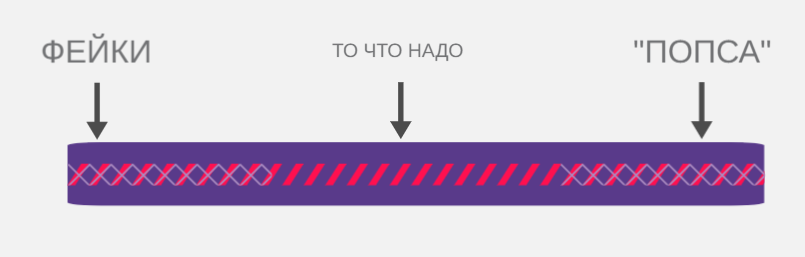

Например, практически любой пользователь быстро понимает что на получение ссылок на веб-сайты в ответ на прямой запрос можно не рассчитывать.

Однако, если Вы попросите создать таблицу, то в ее ячейки он может добавить не только ссылки сайты, но также и иконки(возможно сейчас уже это пофиксили). Это не единственный способ обойти это ограничение.

3 - Запросы “в лоб”

Подавляющую часть всех юзкейсов которые можно встретить в разных twitter-тредах или статьях содержат всего лишь один запрос. Ответ на который либо забавный, либо делает что-то интересное или немного полезное.

Я же пришел к выводу что в целом наиболее продуктивны связки запросов. Когда ответ на первый запрос вы преобразуете с помощью последующих. А часть задач если и решается, то только обходными путями.

Ограничения

Если вы хотите на постоянке использовать возможности новой версии GPT, то нужно хорошо понимать и ее ограничения.

Выдуманные ответы

Длинные перечисления правдоподобных рассуждений со ссылками на выдуманные работы? Легко.

Это первое огорчение с которым Вы столкнетесь при работе с ChatGPT. Еще большая проблема состоит в том что в некоторых случаях довольно сложно отделить фейки от реальных данных. Все ответы выглядят очень правдоподобными.

Ответ может быть выдуманным на многих уровнях. Например, если попросить привести ссылку на главу книги в которой должно быть подтверждение искомых фактов, то можно вскрыть следующие интересные вещи :

- Приведенного Автора в природе может не существовать;

- Книги с приведенным названием может не существовать;

- Искомая книга может существовать, но может затрагивать другой круг вопросов;

- Искомая часть книги может быть отвечать на другие вопросы. К слову указание на конкретную часть книги почти никогда не работает.

Вероятностные ответы

Так как модель вероятностна вследствие этого проявляется ряд нежелательных эффектов. Ответы на один и тот же запрос в одном и том же контексте может различаться. И зависеть от цикла Луны и Меркурия.

Поэтому если вы получаете ответ в духе “я просто языковая модель, и особо ничего не умею”, то попробуйте еще пару раз. Особенно если ранее подобные запросы работали.

Ограничение объема ввода/вывода

Потенциально это не дает реализовать ряд потенциально полезных способы использования вроде выделения основных идей прошедшей он-лайн встречи/митинга. Это если без костылей.

С выводом проще. Для того чтобы продолжить вывод достаточно написать “continue” (продолжай) и вывод будет продолжен. Этого достаточно почти всегда.

“Попсовая” выдача

Я занимаюсь тем что значительно повышаю продуктивность людей которые ко мне обращаются. Теперь и с помощью ChatGPT, кстати.

Однако задачи которые я регулярно решаю для Клиентов ChatGPT решает на 3-4 по 10-тибалльной шкале. То есть это уровень попсовых ответов с первых страниц гугла. Или, возможно, чуть получше.

Дело в том что качество ответов обусловлено материалом на котором обучалась нейросеть. А в большинстве своем материал в интернете является попсой. То есть полуработающие рекомендации которые составляют где-то 20% от качественных решений.

Кидая прямые запросы по интересующим меня темам и подтемам я понял что все плохо. Как минимум тема личной эффективности является одним из драйверов инфоцыган и прочих тренеров успеха. Выдача примерно соответствующая.

Но если делать запросы по менее известной теме, то и ответы более похожи на правду. Их качество на порядок выше. Например, в области нейроэндокринологии. Как минимум ввиду незагаженности. С другой стороны если делать сверхспециализированные запросы то ответы становятся выдуманными. Поэтому здесь можно сделать следующее обобщение :

Распределение источников в зависимости от популярности области

Продолжение следует …

Для того чтобы не пропускать новые материалы вы можете подписаться на мой телеграм канал по теме продуктивности и профессионального развития.

“Автор благодарит членов социальной ячейки издательства Livrezon за вычитку материала”